Moral Machine: dal MIT arriva un sito social per insegnare l'etica alle auto robot in accordo con l'opinione del pubblico

L'ETICA? È UN FATTO SOCIAL La strada verso la guida autonoma è ormai a senso unico e per risolvere la questione etica, ancora molto controversa, il Massachusetts Institute of Technology (MIT) ha escogitato Moral Machine: una piattaforma social in cui si chiede a tutti gli internauti di esprimersi su quali scelte dovrebbero fare i piloti automatici in casi altamente critici. Per esempio, se un'auto a guida autonoma rimasta senza freni dovrebbe decidere se falciare un gruppo di bambini che attraversano col rosso o sterzare e uccidere un gruppo di anziani che passano a semaforo verde.

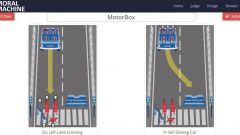

PER PARTECIPARE La piattaforma digitale per esprimere le proprie opinioni si trova sul sito http://moralmachine.mit.edu/, dove è possibile consultare i possibili scenari, proporne di nuovi con un apposito tool e partecipare ai sondaggi votando per ogni sessione 13 situazioni diverse: scelte tra oltre 11 milioni di casi. La piattaforma permette poi di votare i casi ritenuti più interessanti, confrontare le proprie scelte con quelle della media degli altri utenti e pubblicare i propri risultati su Facebook, Twitter, Linkedin, Google+ e per email.

NON È UN TEST DELLA PERSONALITÀ Gli esiti, va detto, presentano di volta in volta “punteggi” incoerenti: ripetendo il test, infatti, nel primo tentativo sembrava che per me fosse importante preservare la legalità e le persone in sovrappeso; al secondo tentativo invece il rispetto delle regole diventava poco rilevante e prediligevo le persone atletiche. Come spiega il disclaimer in calce al resoconto, molto dipende dal diverso mix di scenari proposto, e ciò fa capire quanto sia difficile estrapolare delle regole generali che aiutino le auto a guida autonoma a decidere senza attenersi a casi ben definiti in precedenza.